AI shadow: Khi 69% người dùng AI phải giấu và câu chuyện Việt Nam

Khoảng hai phần ba hài lòng với vai trò của AI trong công việc. Nhưng song song với đó, 69% nói họ cảm thấy có kỳ thị khi dùng AI ở nơi làm việc, nên chọn cách dùng trong im lặng thay vì công khai.

Trong một lớp đào tạo về ứng dụng AI cho ngân hàng gần đây, tôi hỏi vui: “Ai đang dùng ChatGPT hay những công cụ AI tương tự hằng tuần, giơ tay giúp tôi.” Cả phòng im lặng vài giây. Những ánh mắt nhìn nhau, rồi nhìn về phía dãy bàn của các sếp. Những cánh tay giơ lên rất chậm, giống như đang… xin phép hơn là trả lời.

Giờ nghỉ, vài bạn kéo tôi ra hành lang. Có bạn nói nhỏ: “Thầy ơi, em dùng suốt, ngày nào cũng sử dụng. Nhưng trong ngành tụi em nhạy cảm dữ liệu, với lại cũng sợ bị nghĩ là lười biếng, làm tắt, nên không dám giơ tay.”

Đó là phiên bản Việt Nam của một khái niệm đang được nhắc nhiều trên thế giới: AI shadow. Trên bề mặt thì “chưa dùng, chưa cho phép”, nhưng bên dưới là một lớp người đi làm vẫn lặng lẽ sử dụng AI mà không dám công khai .

Điều thú vị là trải nghiệm hành lang rất đời thường đó lại trùng khớp đáng ngạc nhiên với một nghiên cứu gần đây của Anthropic: khoảng 69% người đi làm dùng AI nhưng phải giấu. Không chỉ giấu sếp, mà đôi khi giấu chính đồng nghiệp, giấu luôn cảm giác bất an của mình trước một thế hệ công cụ mới.

1. Từ điển hình lớp học doanh nghiệp đến dữ liệu nghiên cứu

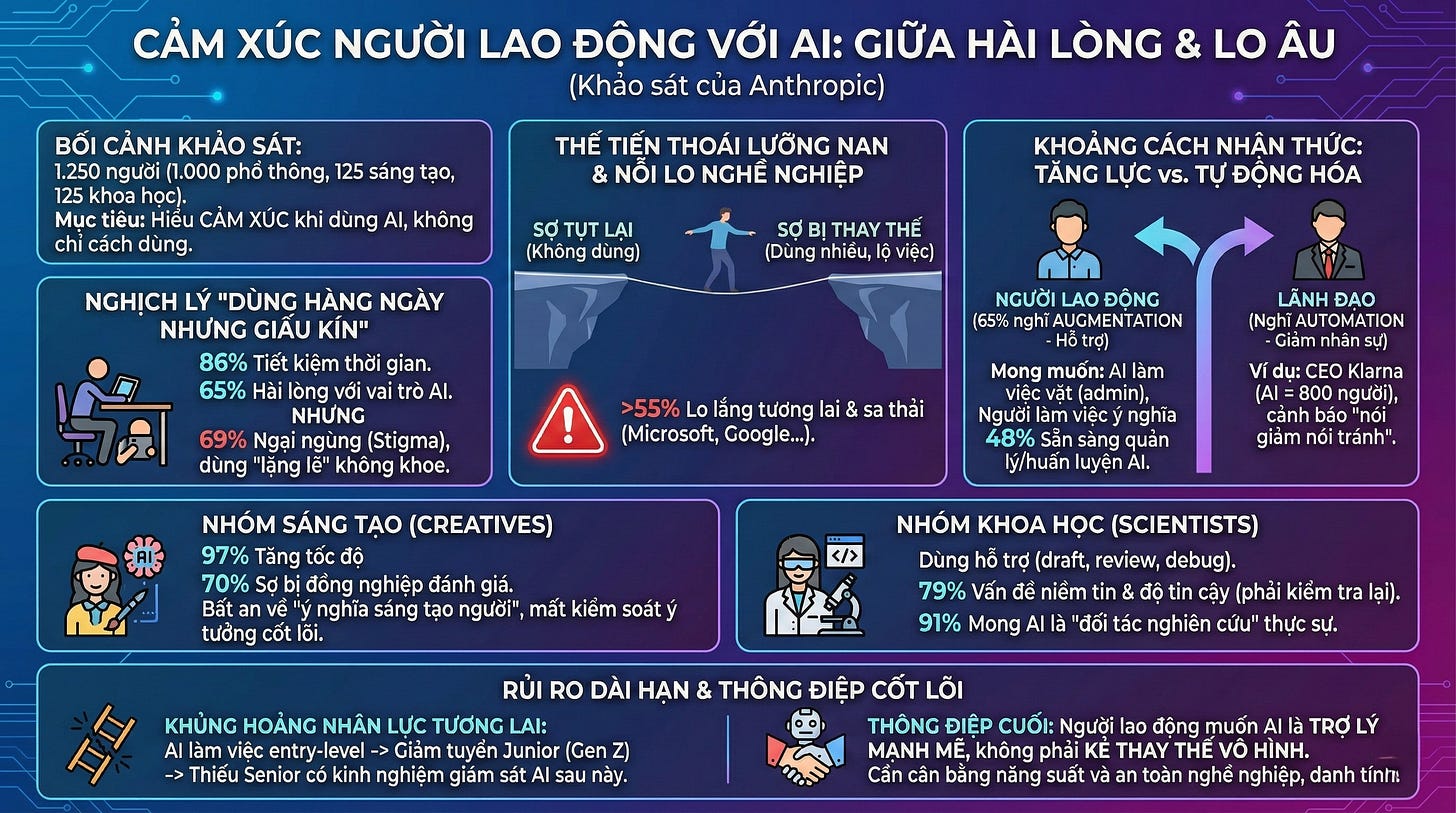

Nghiên cứu của Anthropic khảo sát hơn một nghìn hai trăm người đi làm: chủ yếu là lao động phổ thông, nhóm sáng tạo và nhóm khoa học. Thay vì chỉ hỏi “dùng AI như thế nào”, họ hỏi sâu hơn: “cảm thấy thế nào khi dùng AI trong công việc”.

Kết quả nổi bật có thể tóm gọn như sau. Đa số người tham gia nói họ dùng AI hằng ngày và thừa nhận công cụ giúp tiết kiệm thời gian, làm nhanh hơn, đỡ việc vặt. Khoảng hai phần ba hài lòng với vai trò của AI trong công việc. Nhưng song song với đó, 69% nói họ cảm thấy có kỳ thị khi dùng AI ở nơi làm việc, nên chọn cách dùng trong im lặng thay vì công khai.

Ở nhóm lao động phổ thông, nỗi lo rõ nhất là chuyện “cơm áo gạo tiền”. Họ thấy những đợt sa thải gắn với AI trên báo chí, thấy ngân sách công nghệ tăng lên, số lượng vị trí dịch vụ khách hàng và hỗ trợ bị cắt giảm. Trong đầu họ luôn có hai nỗi sợ: nếu không học dùng AI thì dễ tụt hậu, nhưng nếu dùng quá giỏi thì có khi lại chứng minh rằng vị trí mình đang làm có thể bị tự động hóa.

Ở nhóm sáng tạo, mâu thuẫn nằm giữa tốc độ và bản sắc. Hầu hết đều thừa nhận AI giúp làm nhanh hơn, ra nhiều bản nháp hơn. Nhưng đồng thời, nhiều người sợ bị đồng nghiệp đánh giá là “đồ của máy”, sợ một ngày kia ý tưởng cốt lõi không còn là của mình mà của mô hình. Những ngành như lồng tiếng, minh họa đơn giản, nội dung stock đã thấy rõ sự co hẹp do AI.

Ở nhóm khoa học, vấn đề không phải là “AI có thông minh không” mà là “có tin được không”. Họ dùng AI để nháp bài, đọc tài liệu, debug code, nhưng vẫn dè dặt khi để AI đụng vào các quyết định nghiên cứu: giả thuyết, thiết kế thí nghiệm, đánh giá rủi ro. Một nghịch lý nữa xuất hiện: nhiều việc mà AI làm tốt hiện nay chính là việc của tầng entry level ngày xưa. Nếu tầng này bị co lại, thế hệ trẻ sẽ khó có cơ hội tích lũy đủ trải nghiệm để trở thành những nhà nghiên cứu độc lập, những người giám sát AI sau này.

Từ lớp học ở ngân hàng đến dữ liệu của Anthropic, ta nhìn thấy một trục rất nhất quán: con người cần AI để mạnh lên, nhưng lại sợ AI trở thành lý do khiến mình bị thay thế.

2. Hiện thực Việt Nam: cùng kịch bản, bối cảnh khác

Ở Việt Nam, câu chuyện AI shadow diễn ra trong một bối cảnh rất riêng: vừa chuyển đổi số, vừa chịu áp lực tăng năng suất, vừa mang nặng dấu ấn văn hóa “làm tay” và “giữ hình ảnh” trong môi trường làm việc.

Trong các buổi đào tạo, tôi thường thấy hai thế giới song song. Trên văn bản chính thức, nhiều ngành nhấn mạnh bảo mật dữi liệu, đặc biệt dữ liệu khách hàng theo Nghị định 13. Ở phiên bản mềm hơn thì là: “Cân nhắc khi dùng AI, tránh lộ lọt dữ liệu.” Nhưng phía sau những câu chữ đó lại không có hướng dẫn cụ thể về công việc nào được khuyến khích dùng AI, công việc nào phải xin phép, công việc nào tuyệt đối không nên đụng đến.

Ở phía doanh nghiệp vừa và nhỏ, công ty gia đình, tình hình lại khác. Sếp nhiều nơi đứng giữa hai luồng thông tin: bên ngoài, truyền thông nói “AI là tương lai, không dùng là tụt hậu”; bên trong, đồng nghiệp rỉ tai nhau những câu chuyện “AI cướp việc, AI thay người”. Kết quả là một tư thế rất lưng chừng: không chính thức cấm, cũng không chính thức khuyến khích. Ai muốn dùng thì tự tìm hiểu, tự chịu trách nhiệm, tự… giấu.

Người đi làm Việt Nam vì thế chịu một sức ép kép. Một mặt là áp lực năng suất trong nền kinh tế số: làm được nhiều việc hơn trong ít thời gian hơn, thích nghi với nhịp tăng tốc của công nghệ và sự ngắn lại của hợp đồng lao động. Mặt khác là áp lực giữ hình ảnh: phải tỏ ra giỏi, tự làm được, không lệ thuộc công cụ. Ở giao điểm của hai lực kéo này, AI shadow gần như là phản ứng tự nhiên.

Nếu nghiên cứu của Anthropic nói 69% người đi làm dùng AI mà giấu, cảm nhận của tôi sau nhiều lớp học ở Việt Nam là con số thực tế ở một số ngành có thể còn cao hơn. Không phải vì người Việt “giấu giỏi” hơn, mà vì khoảng trống giữa công nghệ mới và khung chính sách, văn hóa tổ chức còn khá lớn.

3. Đặt câu chuyện vào tam giác công nghệ, chính trị, đạo đức

Để không kẹt trong tranh luận “nên hay không nên dùng AI”, tôi thường đề nghị nhìn câu chuyện qua một khung tam giác tiền nghiệm (a priors): công nghệ, chính trị và đạo đức, vốn là tư duy đặc thủ của bản thân.

Ở khía cạnh công nghệ, AI không còn là một ứng dụng lẻ để cài thêm vào quy trình. Nó là một tầng hạ tầng nhận thức mới, nằm giữa dữ liệu và quyết định. Ở tầng cá nhân, nó giống như một trợ lý biết gần như mọi thứ, trả lời mọi câu hỏi. Ở tầng tổ chức, nó là một lớp tự động hóa, có khả năng thay thế cả cụm công việc vốn do con người đảm nhận. Nếu ta chỉ xem AI như “một cái phần mềm mới, giống như thêm Excel hay thêm email”, ta sẽ bỏ qua việc nó đang tái cấu trúc lại cách tổ chức thu thập dữ liệu, xử lý thông tin và đánh giá con người.

Ở khía cạnh quản trị trong tổ chức, câu hỏi không phải là “AI giỏi đến đâu” mà là “ai có quyền quyết định AI được dùng để làm gì”. Quyền lực nội bộ thường thể hiện qua hai thứ: chỉ tiêu và cách diễn giải chỉ tiêu. Nếu KPI của lãnh đạo tập trung vào giảm chi phí nhân sự, AI gần như mặc định trở thành công cụ cắt người. Nếu KPI nhấn mạnh xây dựng năng lực tri thức dài hạn, AI lại được nhìn như nền tảng tăng lực cho đội ngũ.

“Double bind” mà người lao động cảm thấy, dùng AI thì sợ bị cắt, không dùng thì sợ tụt hậu, thực ra là sản phẩm của một sự im lặng. Miệng thì ta nói “AI chỉ để hỗ trợ”, nhưng mọi ví dụ cụ thể, mọi câu chuyện lan truyền lại xoay quanh việc AI thay bao nhiêu người ở tập đoàn này tập đoàn kia. Khi logic quản trị và logic nghề nghiệp không được đặt thẳng lên bàn, người ở giữa chỉ có thể chọn cách… im lặng và tự xoay xở.

Ở khía cạnh đạo đức nghề nghiệp, câu hỏi khó nhất không còn là “AI làm được gì?”, mà là “ta cho phép mình làm gì với con người khi có AI trong tay?” Ta có trung thực về mức độ dùng AI trong sản phẩm trí tuệ của mình không. Ta có đối xử công bằng với những người chịu rủi ro thay đổi công việc hay không. Ta có bảo vệ được phẩm giá của những nghề gắn với hiện diện con người như giáo viên, bác sĩ, văn nghệ sĩ, mục sư hay không.

Khi một giáo viên muốn AI làm báo cáo hành chính để có thêm thời gian cho học sinh, đó là một hình mẫu đẹp: AI làm hậu trường, con người giữ phần hiện diện, lắng nghe. Nhưng nếu một ngày, bài giảng, lời an ủi, câu chuyện đời sống cũng được viết gần như hoàn toàn bởi AI, ta phải hỏi lại: nghề đó còn là nghề của con người nữa hay không?

4. Chiến lược cá nhân: sống chung với AI mà không đánh mất mình

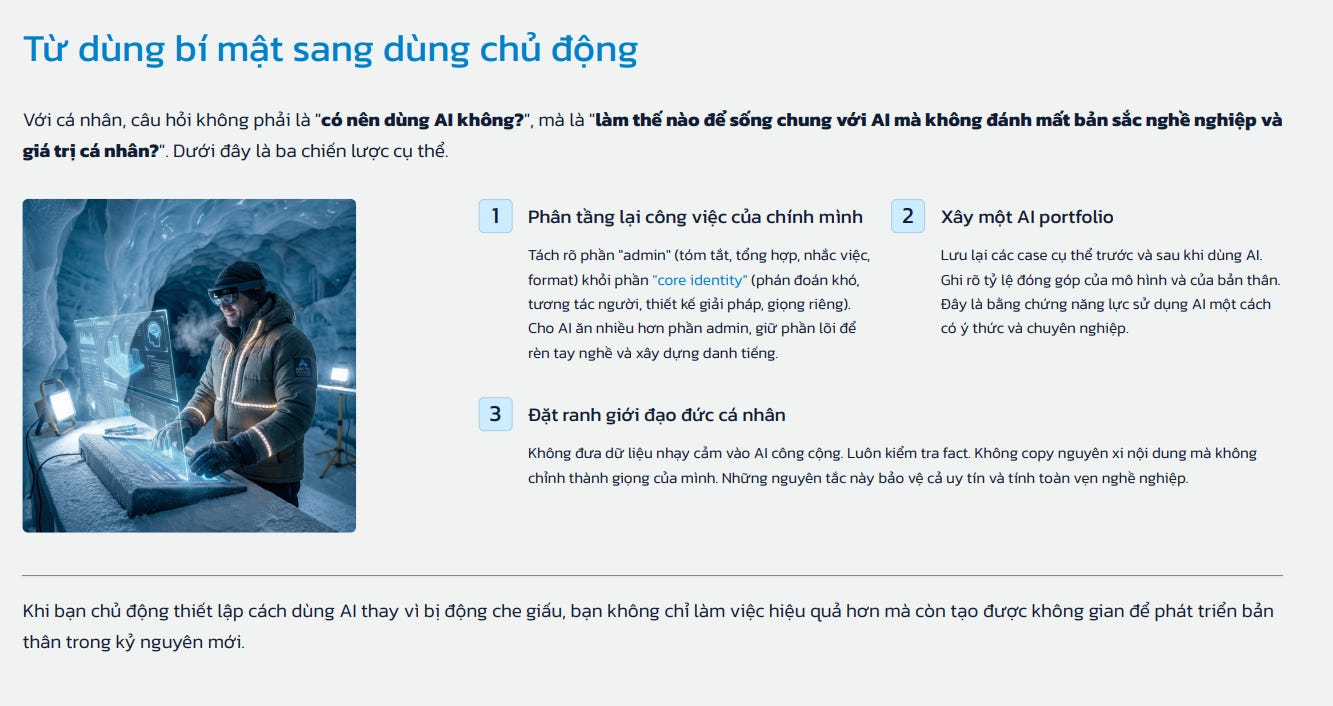

Ở tầng cá nhân, tôi tin rằng chiến lược sống chung với AI bắt đầu bằng việc phân tầng lại chính công việc của mình. Khi ngồi xuống với một tờ giấy trắng, bạnị có thể chia công việc hằng ngày thành hai nhóm. Nhóm thứ nhất là những việc “admin”: tóm tắt, tổng hợp, nhắc việc, sắp xếp lịch, soạn nháp. Nhóm thứ hai là phần “core identity”: phán đoán khó, tương tác người, thiết kế giải pháp, sáng tạo nội dung mang giọng riêng.

Khi đã tách được hai nhóm, ta có thể chủ động cho AI ăn hết phần admin, coi đó là “bàn tay thứ ba”. Thu mình khỏi những thao tác lặp lại không tạo nhiều giá trị, để dành năng lượng cho phần khó hơn nhưng đúng với bản sắc nghề nghiệp. Cách làm này khác rất xa với việc “ném hết cho AI rồi ngồi chơi”. Nó đòi hỏi ta liên tục đặt câu hỏi: phần nào tôi muốn giao cho máy, phần nào tôi muốn giữ lại để rèn tay nghề và danh tiếng.

Bước tiếp theo là xây một “AI portfolio” cho riêng mình. Thay vì nói chung chung “tôi biết dùng AI”, bạn có thể lưu lại một vài trường hợp cụ thể: trước khi dùng AI, mình giải quyết việc đó ra sao; sau khi dùng AI, hiệu quả tăng như thế nào; phần nào là output thô của mô hình, phần nào là quyết định và chỉnh sửa của mình. Qua thời gian, portfolio này vừa giúp bạn nhìn lại hành trình học của chính mình, vừa là chất liệu rất mạnh khi nói chuyện với sếp, với khách hàng, với đối tác.

Một điểm quan trọng nữa là đặt ra các nguyên tắc cá nhân về đạo đức khi dùng AI. Mỗi người có thể chọn cho mình một vài “ranh giới đỏ”: không đưa dữ liệu nhạy cảm lên mô hình công cộng; luôn kiểm tra lại fact trong vùng chuyên môn; nếu AI gợi ý ý tưởng, phải chỉnh sửa để mang giọng của mình, không trích nguyên xi. Nguyên tắc càng rõ, cảm giác tội lỗi và lấn cấn khi dùng AI càng giảm, nhường chỗ cho một sự tự tin có trách nhiệm.

Và cuối cùng, thay vì dừng lại ở vài mẹo prompt, ta có thể bước lên một tầng nữa: hiểu khung. Hỏi xem AI đang thay đổi cấu trúc nghề của mình như thế nào, đường học nghề sẽ đi về đâu, thế hệ trẻ sẽ học ra sao khi entry level được tự động hóa. Đó là phần sense making mà chỉ con người mới làm được, và chính phần đó sẽ quyết định ta là người kéo AI về phía mình hay bị AI kéo đi.

5. Chiến lược tổ chức và ngành: từ shadow AI sang AI governance

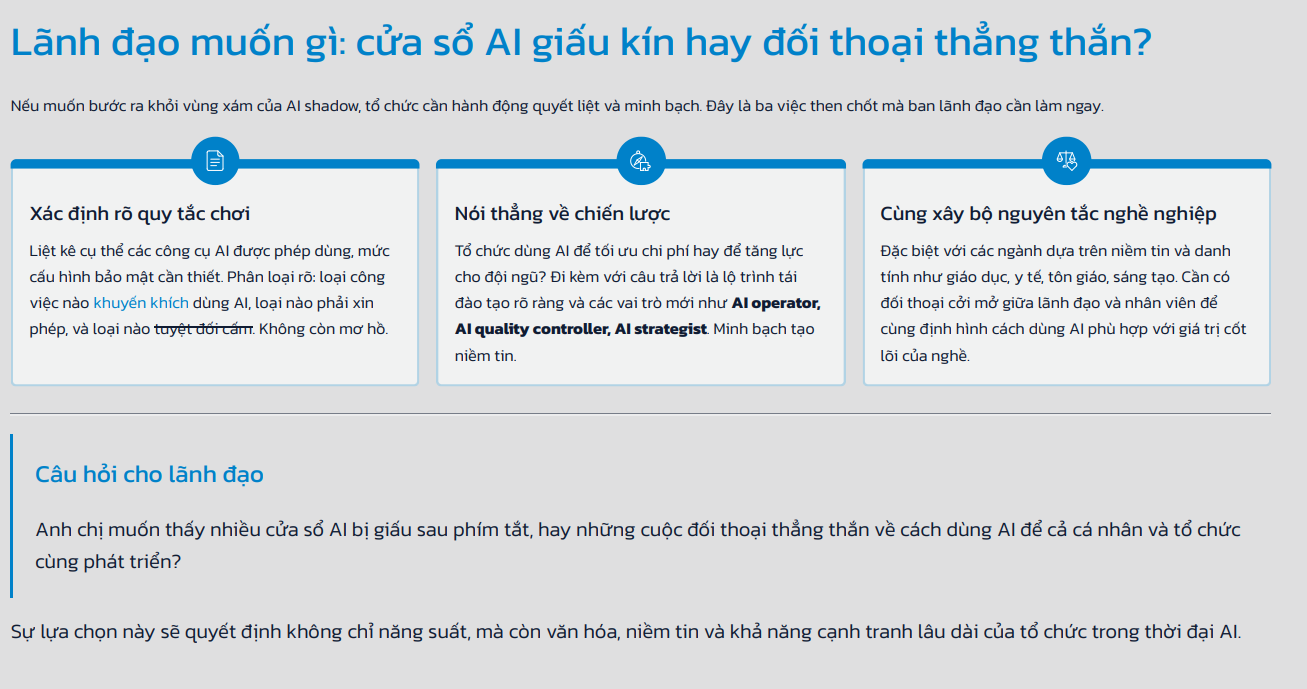

Ở tầng tổ chức, nếu muốn bước ra khỏi vùng xám của AI shadow, tôi nghĩ cần đồng thời chạm vào cả ba cạnh của tam giác: công nghệ, chính trị và đạo đức.

Về công nghệ, điều đơn giản nhất là thôi coi AI như thứ “tự mỗi người lo liệu”. Tổ chức có thể xác định một vài công cụ AI được phép dùng, được cấu hình bảo mật phù hợp, và mô tả rõ những loại công việc nào khuyến khích dùng. Song song, cần có danh mục những việc phải xin phép, những việc tuyệt đối không cho AI đụng vào. Khi ranh giới rõ ràng, nhân viên không phải vừa làm vừa thấp thỏm.

Về quản trị, điều quan trọng nhất là nói thẳng. Nếu chiến lược của doanh nghiệp là dùng AI để tối ưu chi phí, hãy dám đặt lên bàn câu chuyện tái đào tạo, tái bố trí, lộ trình cắt giảm nếu buộc phải cắt. Nếu chiến lược là dùng AI để tăng lực mà vẫn giữ được đội ngũ, hãy mô tả rõ các vai trò mới: AI operator, AI quality controller, AI strategist, thay vì chỉ nói chung chung “mọi người chủ động ứng dụng AI”.

Một bản AI acceptable use policy dài một trang, viết bằng ngôn ngữ dễ hiểu, cụ thể hóa những điểm trên, sẽ hiệu quả hơn rất nhiều so với những khẩu hiệu mơ hồ. Cùng với đó, hệ thống KPI và khen thưởng cũng nên được điều chỉnh: thay vì chỉ khen những người “làm tay” thật nhiều giờ, hãy khen những người biết dùng công cụ thông minh để tạo ra giá trị cao hơn trong cùng quỹ thời gian.

Về đạo đức và văn hóa, tổ chức có thể cùng với người lao động xây một bộ nguyên tắc nghề nghiệp trong thời AI. Không áp đặt từ trên xuống, mà tổ chức các cuộc đối thoại nội bộ: với bộ phận kinh doanh, với kỹ sư, với marketing, với giáo viên, với bác sĩ… Mỗi cộng đồng nghề sẽ có những lo lắng riêng, những ranh giới riêng cần được tôn trọng. Đặc biệt, các nghề dựa trên niềm tin và danh tính như giáo dục, y tế, tôn giáo, sáng tạo càng cần khung đạo đức rõ ràng về việc AI nên đứng ở đâu, hậu trường hay tiền tuyến.

Ở tầng ngành và chính sách, câu chuyện còn rộng hơn. Thời đại công nghệ tăng tốc đã khiến hợp đồng giữa doanh nghiệp và người lao động trở nên ngắn lại và mỏng hơn. AI có thể đẩy nhanh xu hướng đó nếu không có những thiết kế lại về an sinh, đào tạo lại, và tiếng nói của các cộng đồng nghề nghiệp. Đây là lúc chúng ta cần một cuộc đối thoại nghiêm túc về “Khế ước xã hội mới” trong kỷ nguyên AI: ai chịu rủi ro, ai hưởng lợi, và trách nhiệm chia sẻ ra sao.

6. Lời mời suy nghĩ

Trở lại lớp học ngân hàng ở đầu bài. Cánh tay giơ lên chậm chạp, ánh mắt liếc nhìn nhau, những cuộc trao đổi vội ở hành lang… đó không chỉ là chuyện một buổi học, mà là dấu hiệu của một trạng thái chuyển tiếp lớn hơn rất nhiều. Từ nghiên cứu của Anthropic đến những gì tôi thấy ở Việt Nam, có thể tóm lại một câu: con người vừa cần AI để mạnh hơn, vừa sợ AI làm mình trở nên thừa thãi.

Cách thoát, theo tôi, không nằm ở hai cực “cấm đoán” hoặc “thả nổi”, cũng không nằm ở việc tiếp tục dùng chui. Cách thoát nằm ở chỗ chúng ta dám đặt tên, đặt luật và đặt lại vai trò của mình trong tam giác công nghệ, chính trị và đạo đức. Đặt tên cho những gì đang diễn ra: AI shadow, double bind, augmentation hay automation. Đặt luật cho việc dùng AI ở tầng cá nhân, tổ chức, ngành. Và đặt lại vai trò của con người không phải như những mắt xích có thể thay thế, mà như những người trông nom, thiết kế và chịu trách nhiệm cuối cùng.

Câu hỏi tôi muốn để lại cho các lãnh đạo là trong đội ngũ của mình hôm nay, anh chị muốn thấy nhiều cửa sổ AI bị giấu đi sau những phím tắt, hay muốn thấy những cuộc đối thoại thẳng thắn về cách dùng AI để tất cả cùng phát triển, cá nhân và tổ chức?